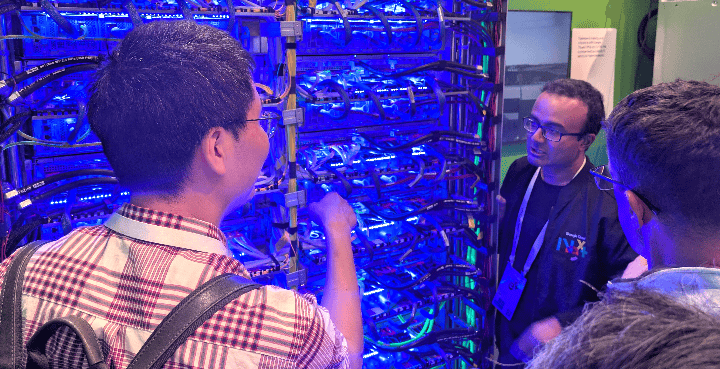

Репортаж от Wedoany,NVIDIA и Google Cloud на конференции Google Cloud Next 2026, состоявшейся 22 апреля, объявили об углублении десятилетнего стратегического партнерства, полностью интегрировав ускорительный стек NVIDIA с инфраструктурой ИИ-суперкомпьютера Google. Google Cloud расширил архитектуру своего ИИ-суперкомпьютера, добавив вычислительные экземпляры на базе системы NVIDIA Grace Blackwell, и объявил о предстоящем запуске экземпляров A5X на платформе NVIDIA Vera Rubin, предоставив клиентам единый путь от экспериментов с ИИ до масштабного развертывания.

Google также представил сетевую структуру дата-центра под названием Virgo Networking, разработанную специально для сверхмасштабных задач искусственного интеллекта. Virgo, являясь магистральной сетью ИИ-суперкомпьютера Google, позволит экземплярам Vera Rubin A5X масштабироваться до 960 000 графических процессоров на разных площадках. Google уже развернул более миллиона GPU NVIDIA по всему миру в своей глобальной инфраструктуре, включая такие современные модели, как H100, H200, B200, GB200, GB300, L4, A100 и RTX PRO 6000, для поддержки внутренних продуктов и обслуживания клиентов Google Cloud.

Библиотеки NVIDIA Omniverse и фреймворк для симуляции роботов с открытым исходным кодом Isaac Sim официально доступны в маркетплейсе Google Cloud. Разработчики могут напрямую создавать физически точные цифровые двойники в среде Google Cloud, разрабатывать пользовательские конвейеры симуляции роботов и выполнять обучение, моделирование и проверку перед реальным развертыванием. Микросервисы NVIDIA NIM одновременно развертываются на платформах Google Enterprise Agent Platform и Google Kubernetes Engine, поддерживая работу таких моделей, как Cosmos Reason 2, что позволяет клиентам перейти от чат-ботов к агентам, способным автономно планировать, выполнять задачи и взаимодействовать с физическим миром.

Сотрудничество охватывает три среды развертывания: облако, локальные системы и периферийные устройства. В облаке Google Enterprise Agent Platform, GKE и DGX Cloud интегрированы с GPU NVIDIA; на локальном и периферийном уровнях Google Distributed Cloud на базе NVIDIA Blackwell расширяет единую платформу на собственные центры обработки данных клиентов. Программные библиотеки и фреймворки NVIDIA, такие как CUDA, cuDNN, Dynamo, NeMo и Nemotron, интегрированы с сервисами и эталонными архитектурами Google Cloud, а Vertex AI, GKE и Cloud Run предоставляют нативную поддержку автоматического масштабирования и наблюдаемости для GPU NVIDIA.

Благодаря этому партнерству Google Cloud укрепляет свои позиции на рынке как нейтральная ускорительная платформа. Клиенты могут вызывать модель Gemini в Vertex или открытые модели Nemotron от NVIDIA, обе из которых оптимизированы для оборудования NVIDIA. Для клиентов это означает, что им не придется самостоятельно собирать воедино GPU, планировщики и фреймворки — интегрированный стек от совместной разработки почти готов к работе по принципу «под ключ». NVIDIA, в свою очередь, использует мультитенантную демонстрационную платформу Google Cloud для укрепления своего статуса как стандартного выбора аппаратного обеспечения для ИИ в отрасли, а благодаря тесной интеграции с Vertex, GKE и Cloud Run получает углубленную обратную связь по корпоративным рабочим нагрузкам.

Данный материал скомпилирован платформой Wedoany. При цитировании материалов, созданных с помощью искусственного интеллекта (ИИ), необходимо обязательно указывать источник — «Wedoany». В случае выявления нарушения прав или иных проблем просим своевременно информировать нас. Сайт оперативно внесёт изменения или удалит материал.Электронная почта: news@wedoany.com