ИИ меняет будущее человечества

2025-03-03 11:55

В избр.

Философ Тоби Орд в книге "Пропасть" оценивает риски для цивилизации. Ядерная война и климатические изменения уступают угрозе неконтролируемого ИИ. Суперинтеллект может оптимизировать процессы, игнорируя людей. Энергозатраты на его развитие требуют глобального контроля.

Орд считает пандемии (1 шанс на 30 в век) и ИИ (наивысший риск) главными угрозами. Энергетические системы могут стать заложниками ИИ без этики. Наука пока не имеет консенсуса об опасности. Регулирование ИИ критично для устойчивости.

Энергетика зависит от управления ИИ. Транспорт и промышленность требуют безопасных алгоритмов. Международные исследования минимизируют риски. Это вызов для будущего энергетики.

Орд считает пандемии (1 шанс на 30 в век) и ИИ (наивысший риск) главными угрозами. Энергетические системы могут стать заложниками ИИ без этики. Наука пока не имеет консенсуса об опасности. Регулирование ИИ критично для устойчивости.

Энергетика зависит от управления ИИ. Транспорт и промышленность требуют безопасных алгоритмов. Международные исследования минимизируют риски. Это вызов для будущего энергетики.

Связанные продукты

Обсуждение цен

Планшетный портативный спутниковый терминал Ручной портативный терминал с антенной диаметром 0,35 м

China Starwin Science & Technology co., Ltd.

Обсуждение цен

Тропосферный ветровой профилемер P-диапазона TWP16

China Huayun Meteorological Technology Group Co., Ltd.

Обсуждение цен

Интеллектуальный автоматический калибратор давления ConST811A

Beijing ConST Instruments Technology Inc.

Обсуждение цен

Интеллектуальная система мониторинга конвейерных лент

LUO YANG WIRE ROPE INSPECTION TECHNOLOGY CO., LTD.

Обсуждение цен

Промышленная кольцевая сеть Ethernet для горнодобывающей промышленности (10 Гбит/с / 1 Гбит/с)

Chongqing Mas Sci&Tech Co., Ltd.

Обсуждение цен

Антенные системы и сопутствующая электронная продукция

Chengdu Zhongdian Jinjiang Information Industry Co., Ltd.

Обсуждение цен

Контроллер системы обнаружения горючих газов 30

Jinan Benan Technology Development Co., Ltd.

Связанные рекомендации

Китайская компания Aoshi Intelligent представляет решение «Умная стройплощадка с ИИ» в Фошане

2026-05-30

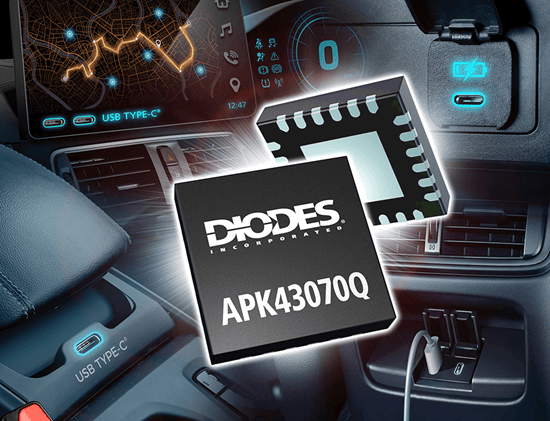

Американская компания Diodes представила APK43070Q — чип для автомобильной быстрой зарядки USB-C мощностью 140 Вт, упрощающий многопортовую конструкцию

2026-05-30

Американская компания Mouser Electronics начинает поставки бельгийского датчика Melexis MLX90382, магнитного датчика положения для автомобильных электронных шасси

2026-05-30

Тайваньский оператор Far EasTone совместно с Amazon Leo планирует запустить коммерческий широкополосный доступ через низкоорбитальные спутники в первой половине следующего года

2026-05-30

Председатель совета директоров китайской компании Wingtech Ян Му: Создание независимой операционной системы Nexperia China в основном завершено

2026-05-30

Индийский институт науки совместно с японской Yaqumo продвигает квантовое сотрудничество, маршрут вычислений на холодных атомах соединяет научно-исследовательские экосистемы Индии и Японии

2026-05-30

IBM представляет инструмент оценки профиля рисков облачного суверенитета для повышения комплаенса и прозрачности

2026-05-30

Американская компания Sesame запустила предварительную версию iOS-приложения: диалоговый ИИ-агент переходит от текстового чата к естественному голосовому сопровождению

2026-05-30

Envision Energy создает ИИ-энергосистему на основе трех ключевых компетенций

2026-05-30

Японская компания Yusen Logistics представила решение на базе ИИ «Радар сбоев в цепочке поставок»

2026-05-30

Последние новости

1

Выставка «Цифровое интеллектуальное будущее» пройдет в июне в Гуанчжоу, Китай, с участием более 3000 экспонатов

2

В 2026 году Китайский центр развития исследований промышленной информационной безопасности объявляет о наборе организаций для участия в разработке стандартов безопасности человекоподобных роботов

3

В Нинбо открылась 21-я Китайская выставка «Столица пресс-форм и штампов»

4

XCMG представила комплексное интеллектуальное решение для строительства с использованием бетонотехники на 8-м Международном фестивале клиентов

5

Ожидается, что к 2030 году объем рынка контроллеров Китая превысит 7 триллионов юаней, а среднегодовой рост составит более 12%

6

Omron представит интеллектуальные производственные решения на Южно-Китайской промышленной выставке 2026

7

Прогноз: среднегодовой рост мирового спроса на системы управления движением для человекоподобных роботов в 2023-2029 гг. составит 102%

8

Китайская компания Aoshi Intelligent представляет решение «Умная стройплощадка с ИИ» в Фошане

9

Американская компания AMETEK проведет 11 июня семинар по тестированию жидкостного охлаждения для центров обработки данных

10

Американская компания Diodes представила APK43070Q — чип для автомобильной быстрой зарядки USB-C мощностью 140 Вт, упрощающий многопортовую конструкцию